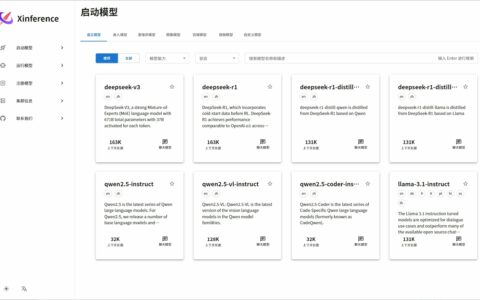

Xinference

-

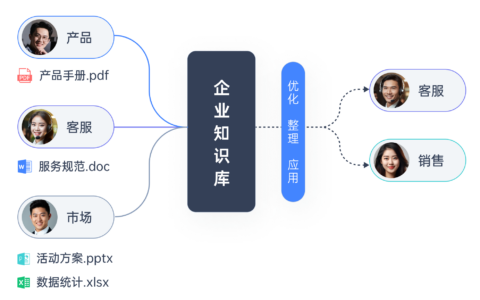

4 x 2080Ti 22G Ubuntu服务器部署大语言模型+企业知识库的最优方案

经过反复试验测试,在四张22G的2080Ti Ubuntu操作系统的服务器上,部署企业知识库的最优方案如下: Xinference + MaxKB或RAGFlow + Open-W…

-

Ubuntu服务器Xinference的部署流程

Xorbits Inference(Xinference)是一个性能强大且功能全面的分布式推理框架。可用于大语言模型(LLM),语音识别模型,多模态模型等各种模型的推理。通过 Xo…