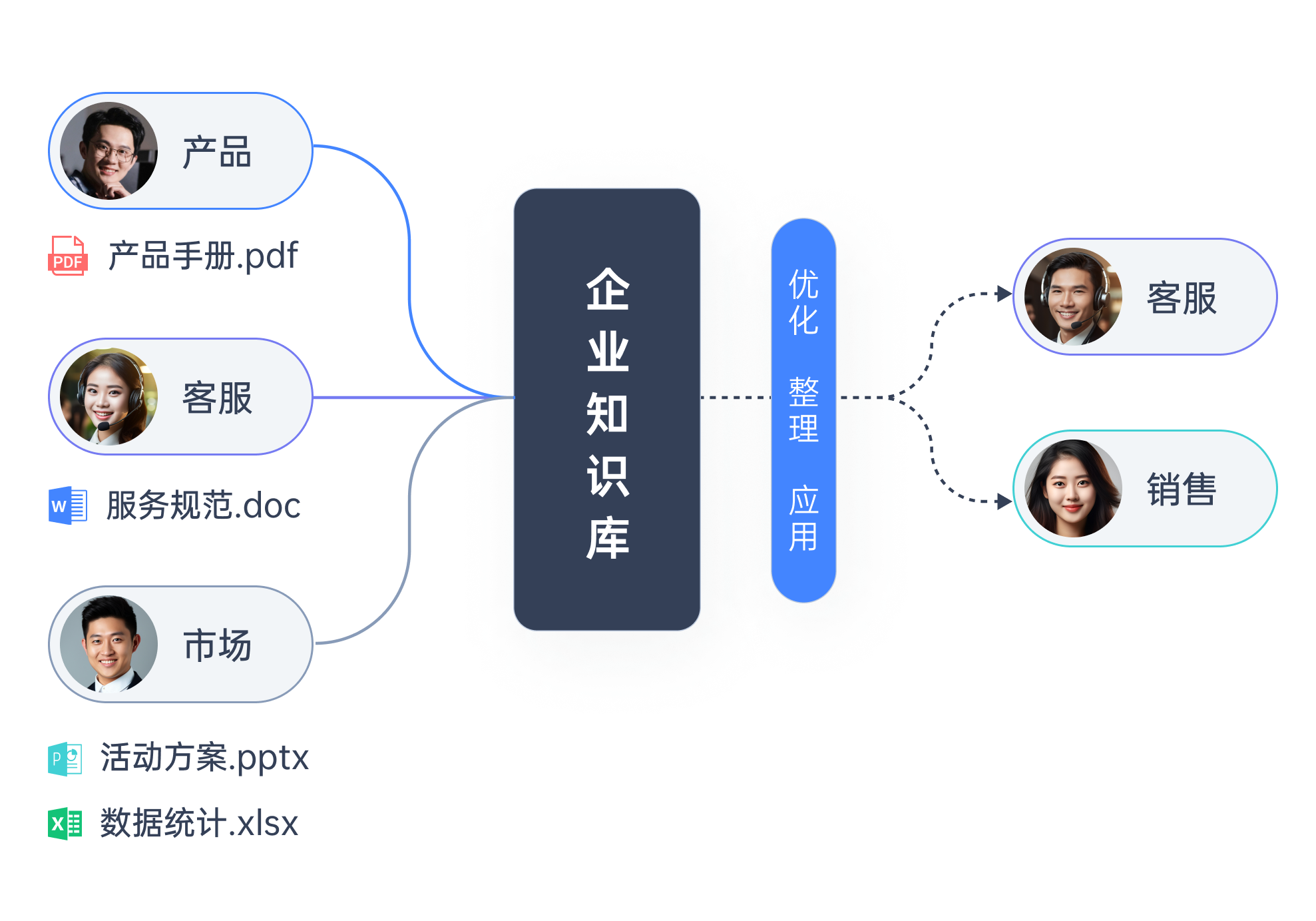

经过反复试验测试,在四张22G的2080Ti Ubuntu操作系统的服务器上,部署企业知识库的最优方案如下:

Xinference + MaxKB或RAGFlow + Open-Webui

Xinference和Open-Webui都可以通过conda的虚拟环境来安装;

MaxKB和RAGFlow需要通过docker来安装;

交付给企业客户的一般是MaxKB或者RAGFlow,而Xinference可以在后台为MaxKB和RAGFlow提供向量模型(jina-embeddings-v3)和重排模型(bge-reranker-v2-m3)

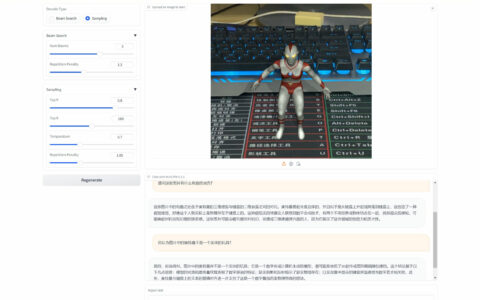

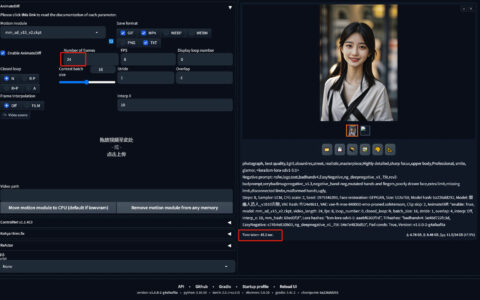

当然如果偷懒的方法还可以从Xinference同时提供大语言模型deepseek-r1的32B或者32B的量化版,但是经过实际测试发现Xinference部署的deepseek-r1 32B和32B的量化版模型都会有一个问题,就是丢失<think>,导致客户使用MaxKB或者open-webui的时候,无法在web页面正常显示思考的内容,所以不建议这么做;

因此,我单独用vllm运行了一个DeepSeek-R1-Distill-Qwen-32B的模型(32768的len、10并发、大约14-20tokens/秒),并且通过oneapi来对MaxKB和RAGFlow以及open-webui提供Openai的兼容API;

由于4张22G的2080Ti显卡在运行FP16的DeepSeek-R1-Distill-Qwen-32B模型,几乎用完了所有的显存,因此,Xinference中的向量模型(jina-embeddings-v3)和重排模型(bge-reranker-v2-m3)必须用CPU来运行,不过型号这两个模型都比较小,CPU运行完全没有问题!

上述方案可以满足一个小型企业的日常使用!

原创文章,作者:朋远方,如若转载,请注明出处:https://caovan.com/4-x-2080ti-22g-ubuntufuwuqibushudayuyanmoxingqiyezhishikudezuiyoufangan/.html

微信扫一扫

微信扫一扫