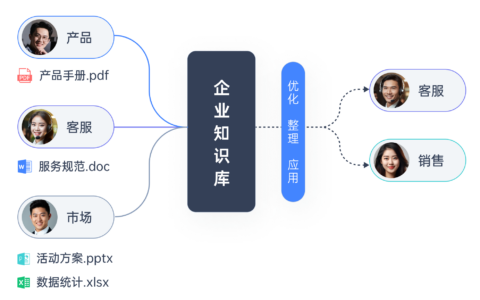

在上一篇文章里面,我们详细地讲解了如何在windows系统下面安装WSL、Docker Desktop、FastGPT、m3e、oneapi来部署本地的AI知识库!只不过我们调用的是ChatGLM3-6B大模型,如果对这些内容尚不了解的话,可以移步到《Windows+WSL+Docker Desktop+FastGPT+m3e+oneapi+ChatGLM3部署本地AI知识库》!

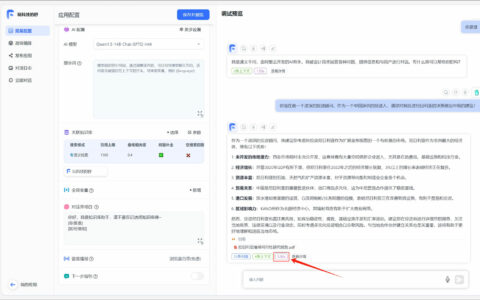

本文我们将主要讲解如何将本地的Qwen-14B大模型接入到FastGPT知识库!

下载仓库文件

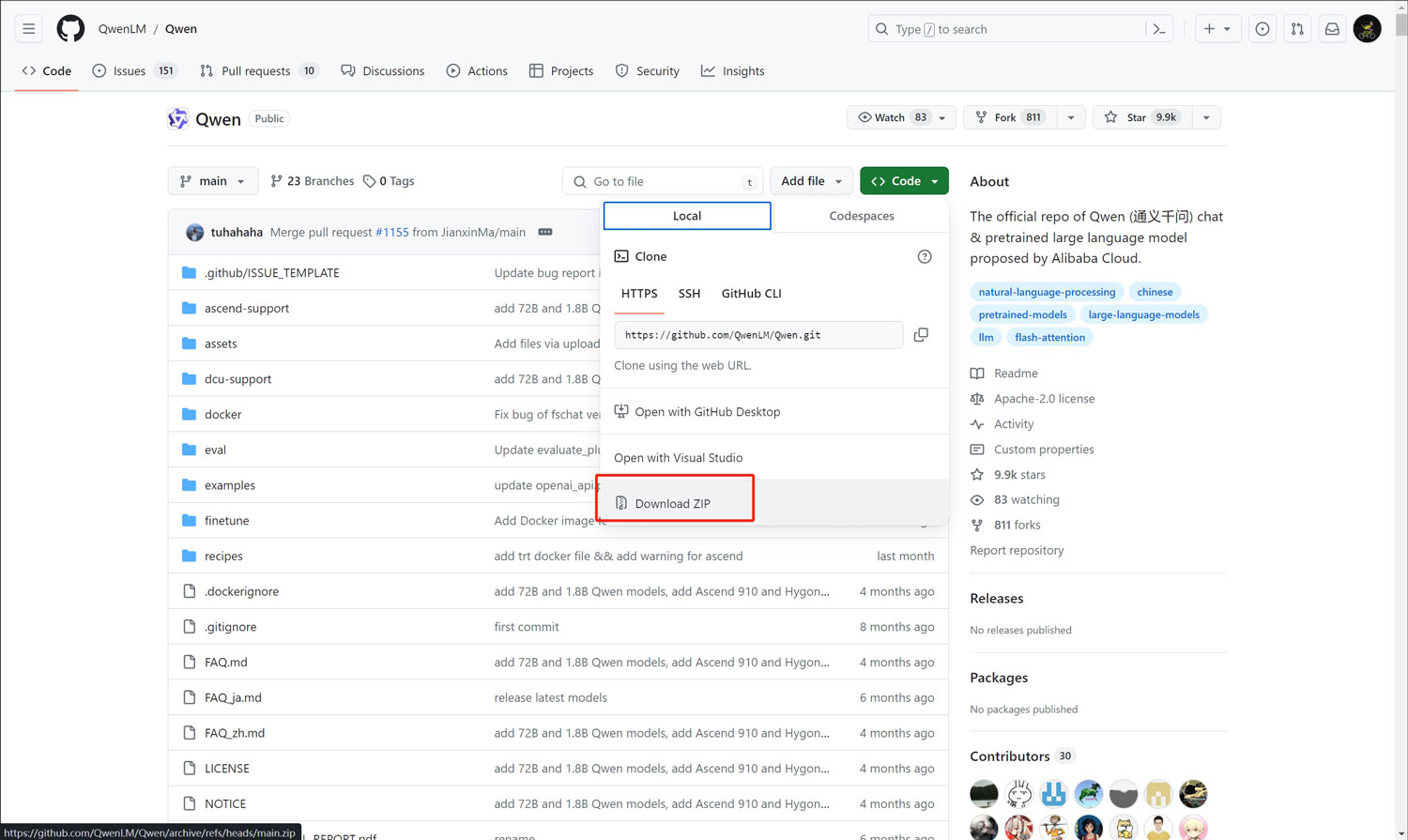

Qwen的github主页地址:https://github.com/QwenLM/Qwen

将该仓库文件克隆到本地!

第一种方法:下载压缩包到本地解压

点击github主页的“code”下拉选项,选择“Download ZIP”,然后将下载的zip压缩包解压到想要的位置!

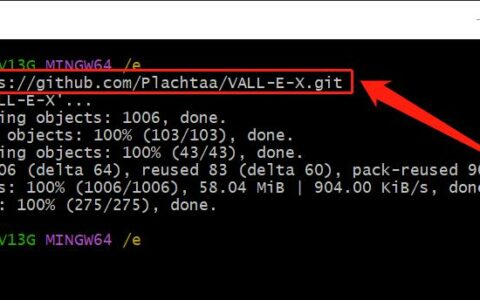

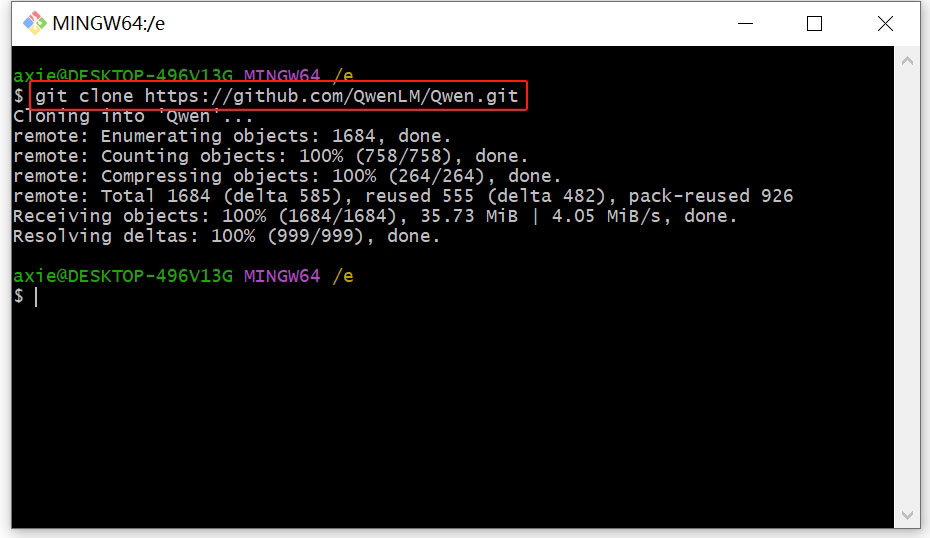

第二种方法:通过git命令克隆到本地

在文件夹的空白处点击右键,选择“Git Bash Here”,输入下面的这行命令:

git clone https://github.com/QwenLM/Qwen.git

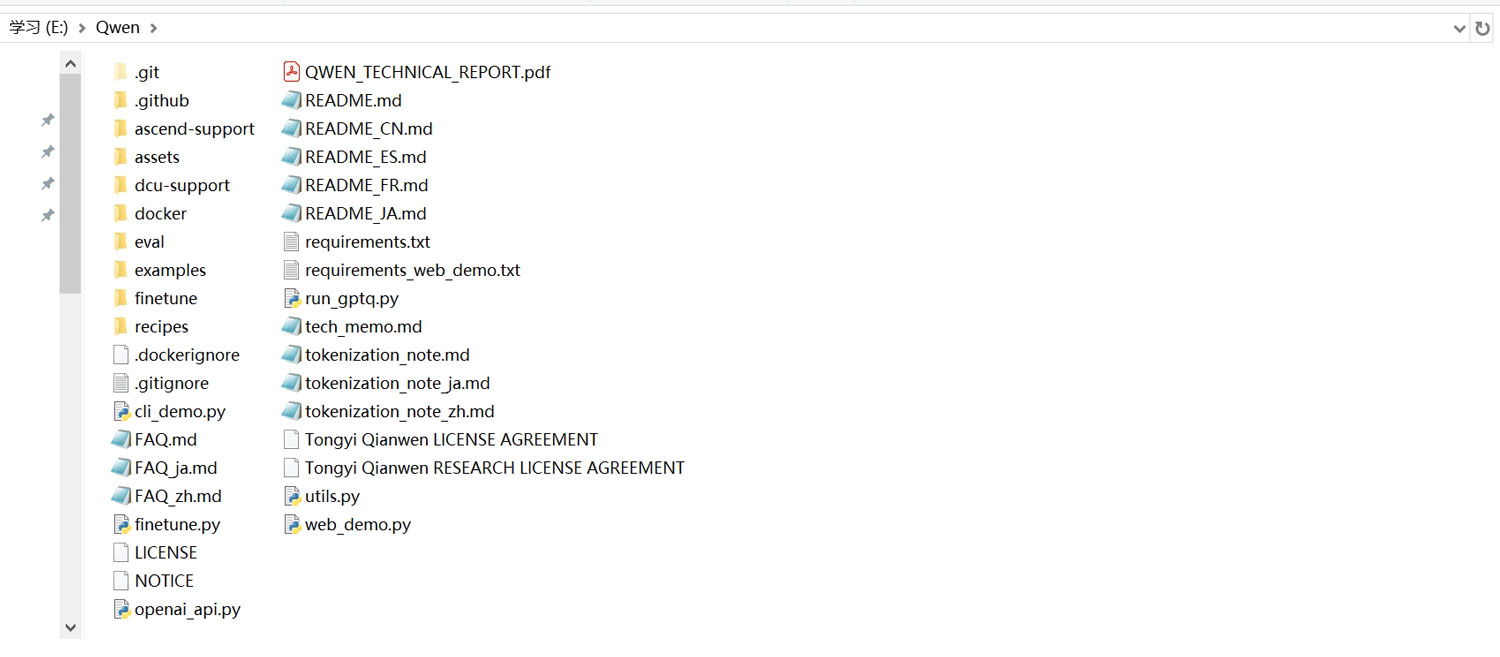

不管我们用的是那种方法,最后我们都会得到一个下面的文件夹!

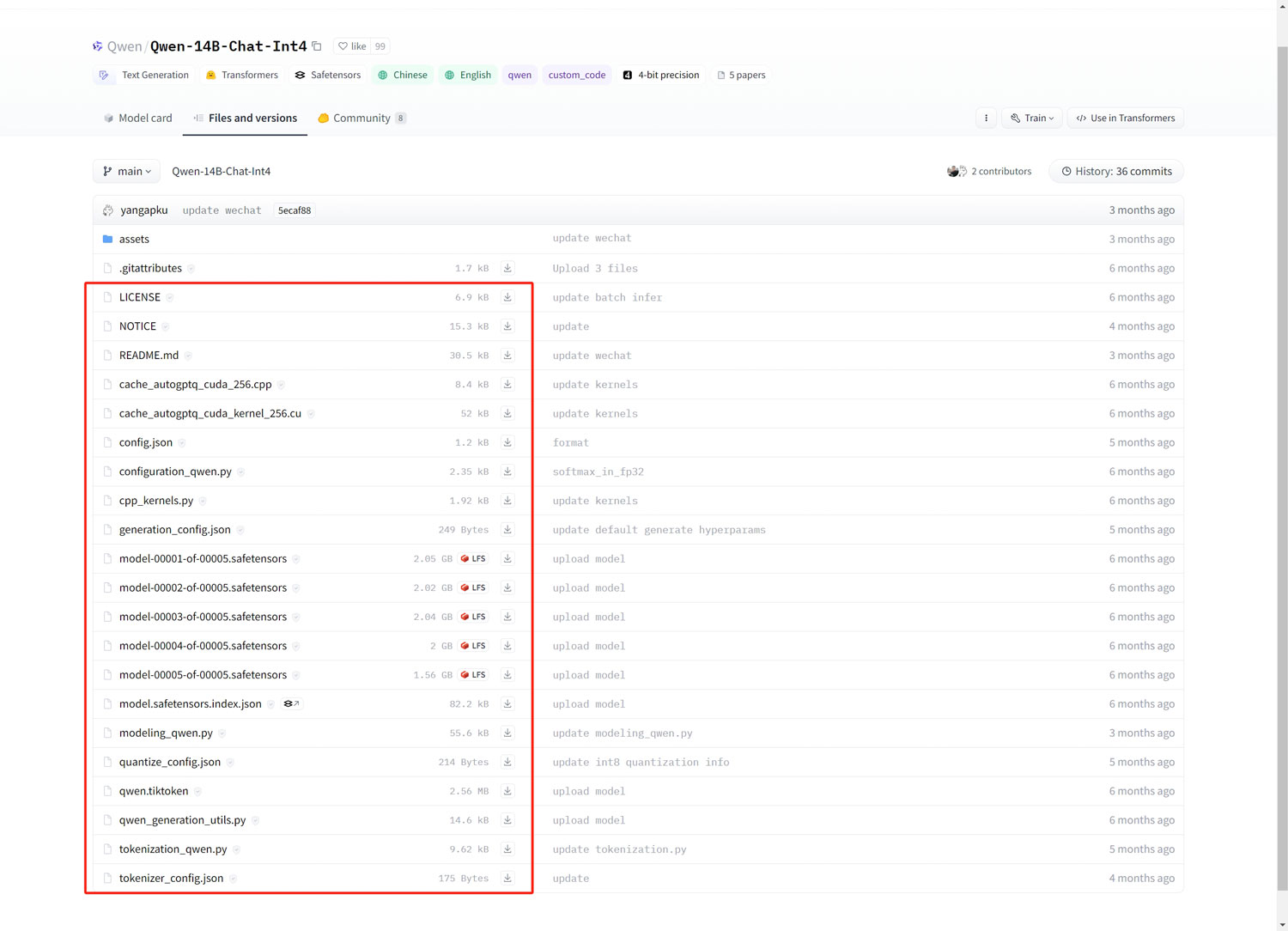

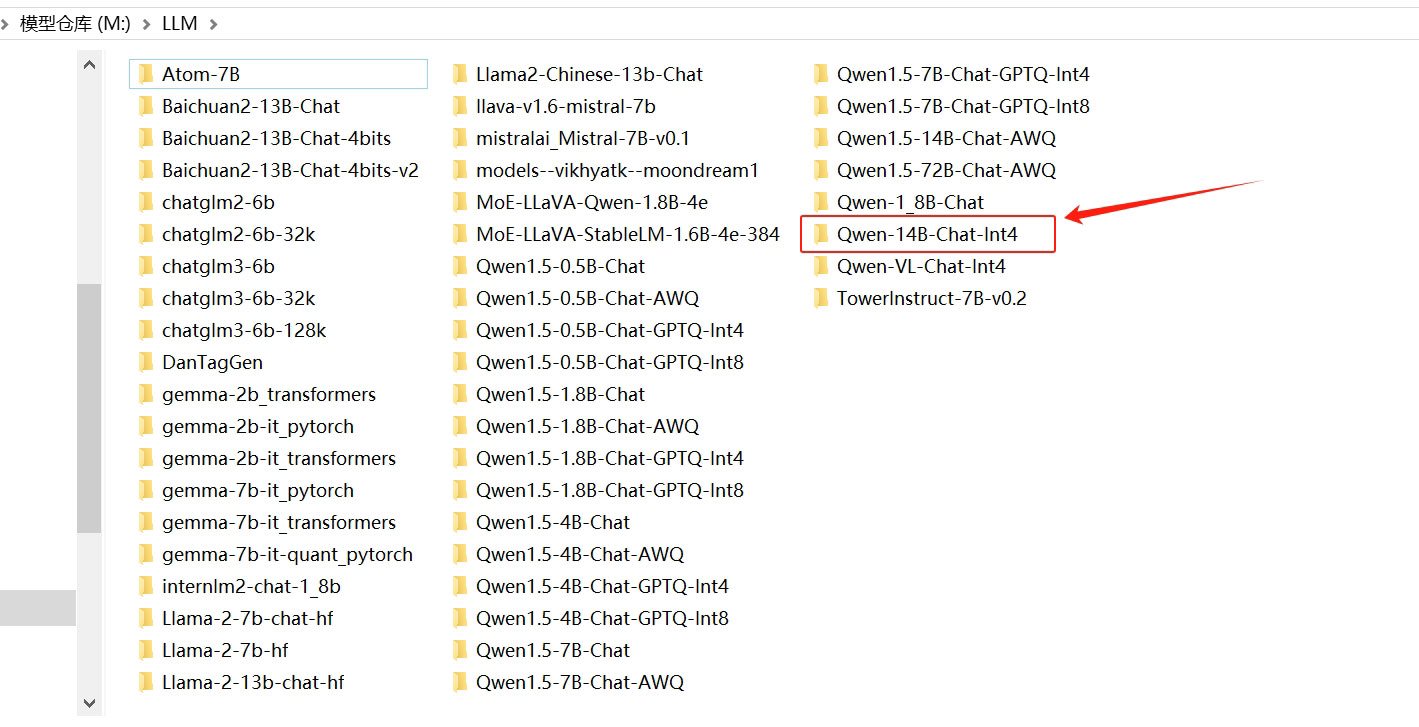

下载权重文件

权重文件的huggingface页面:https://huggingface.1319lm.top/Qwen/Qwen-14B-Chat-Int4/tree/main

我们选择4位精度的版本,这样对显存的压力比较小!将页面中所有的文件都下载下来,保存到一个你想要的位置!文件夹的名称可以就为“Qwen-14B-Chat-Int4”

原创文章,作者:朋远方,如若转载,请注明出处:https://caovan.com/windowswsldocker-desktopfastgptm3eoneapiqwen-14bbushubendeaizhishiku/.html

微信扫一扫

微信扫一扫