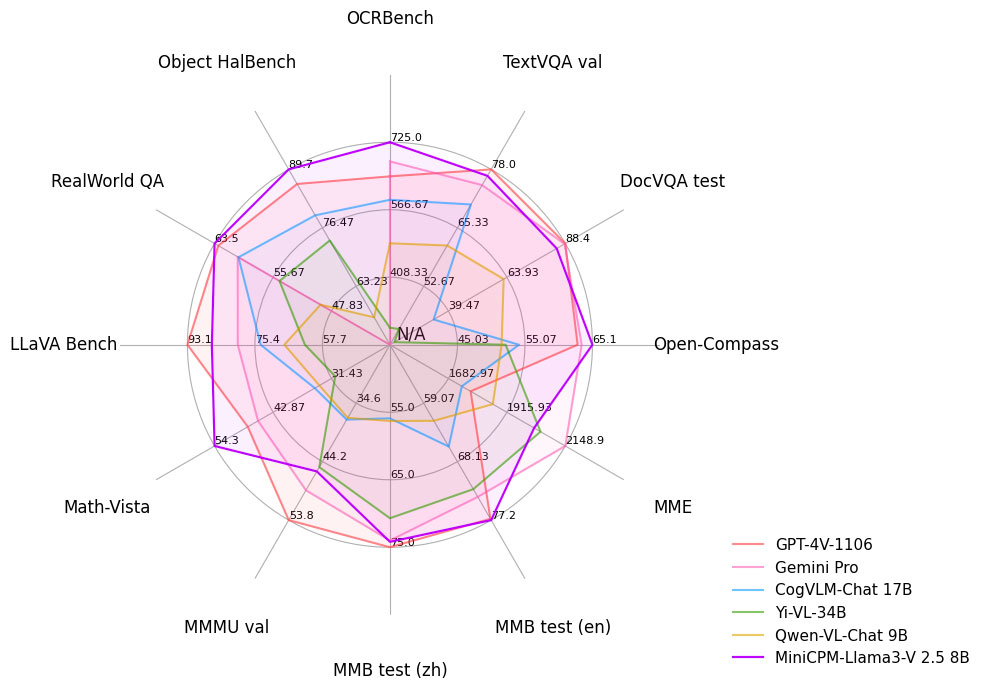

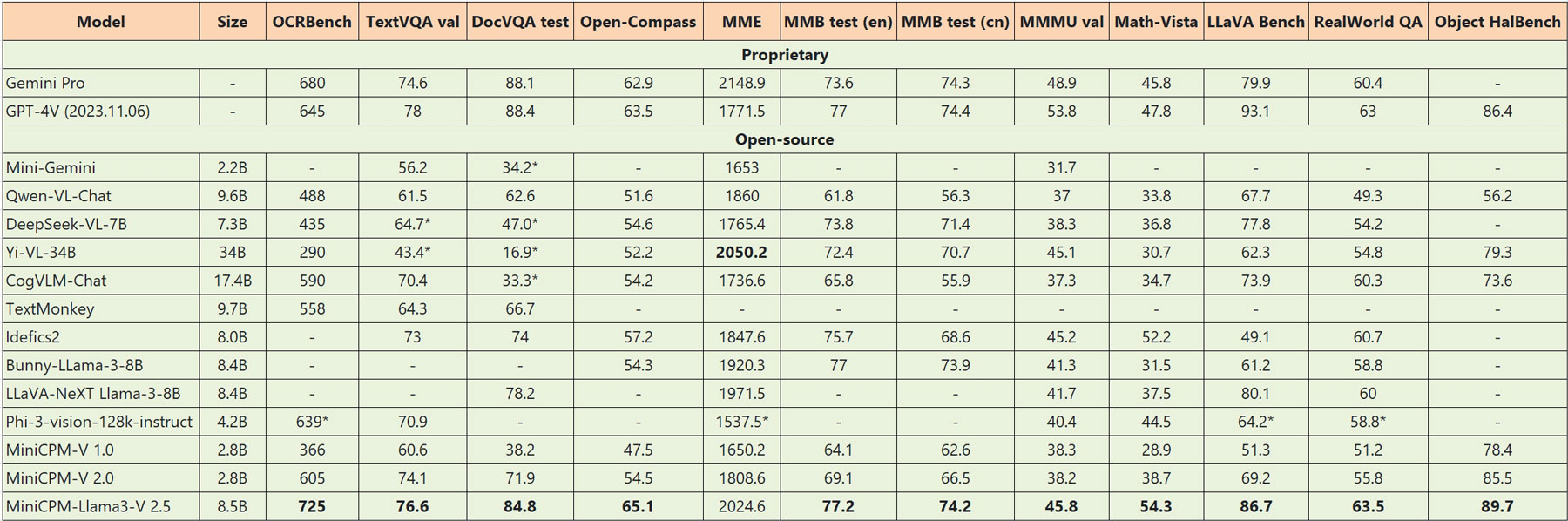

MiniCPM-Llama3-V 2.5 是 MiniCPM-V系列的最新、性能最佳模型。总参数量8B,多模态综合性能超越 GPT-4V-1106、Gemini Pro、Claude 3、Qwen-VL-Max 等商用闭源模型,OCR 能力及指令跟随能力进一步提升,并支持超过30种语言的多模态交互。通过系统使用模型量化、CPU、NPU、编译优化等高效推理技术,MiniCPM-Llama3-V 2.5 可以实现高效的终端设备部署。

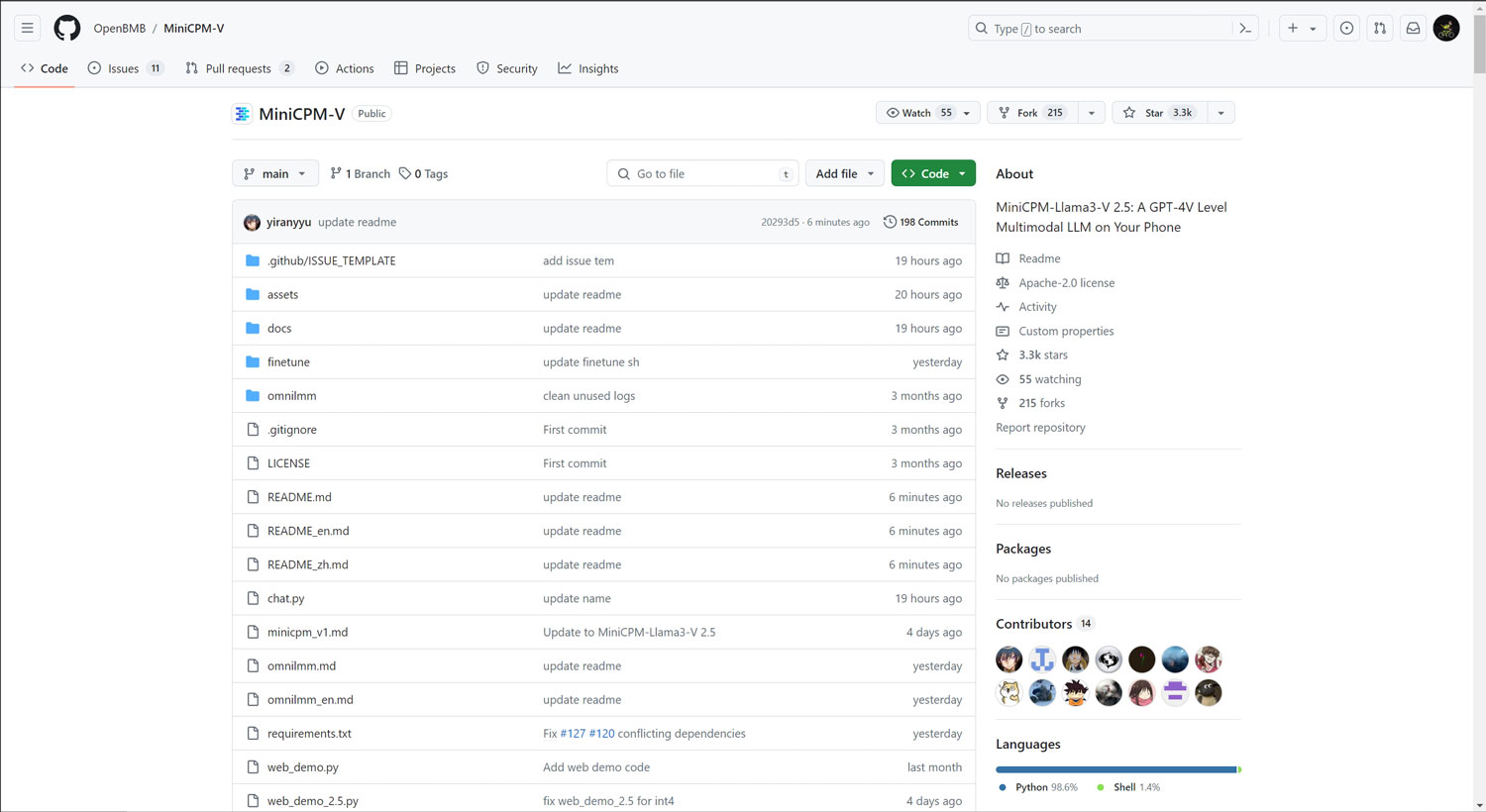

项目和模型地址

项目地址

项目的GitHub主页:https://github.com/OpenBMB/MiniCPM-V

模型下载

MiniCPM-Llama3-V-2_5模型下载地址:

huggingface:https://huggingface.co/openbmb/MiniCPM-Llama3-V-2_5

魔搭社区:https://modelscope.cn/models/OpenBMB/MiniCPM-Llama3-V-2_5

MiniCPM-Llama3-V-2_5-int4模型下载地址:

huggingface:https://huggingface.co/openbmb/MiniCPM-Llama3-V-2_5-int4

魔搭社区:https://modelscope.cn/models/OpenBMB/MiniCPM-Llama3-V-2_5-int4

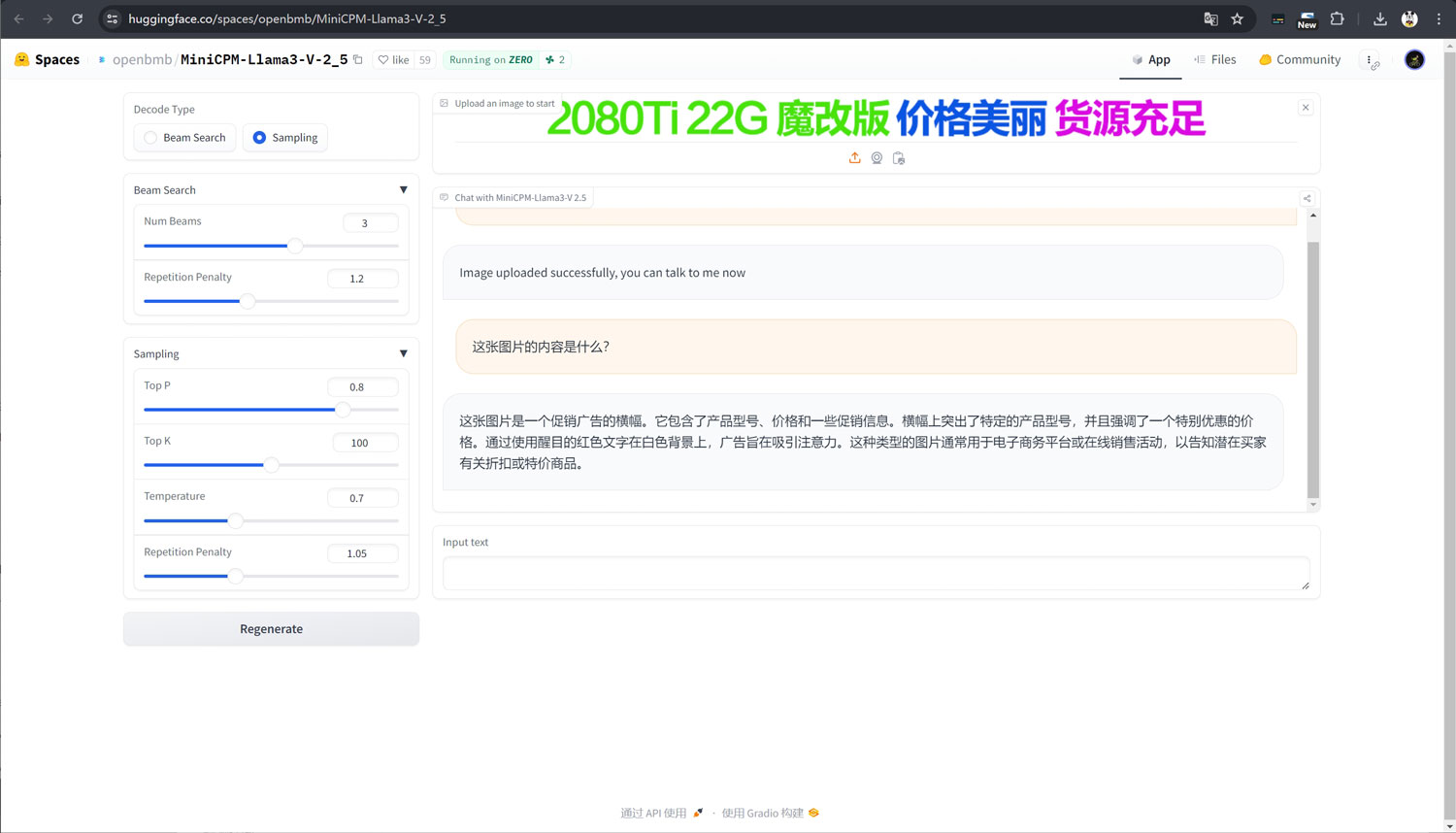

在线体验

在线体验地址:https://huggingface.co/spaces/openbmb/MiniCPM-Llama3-V-2_5

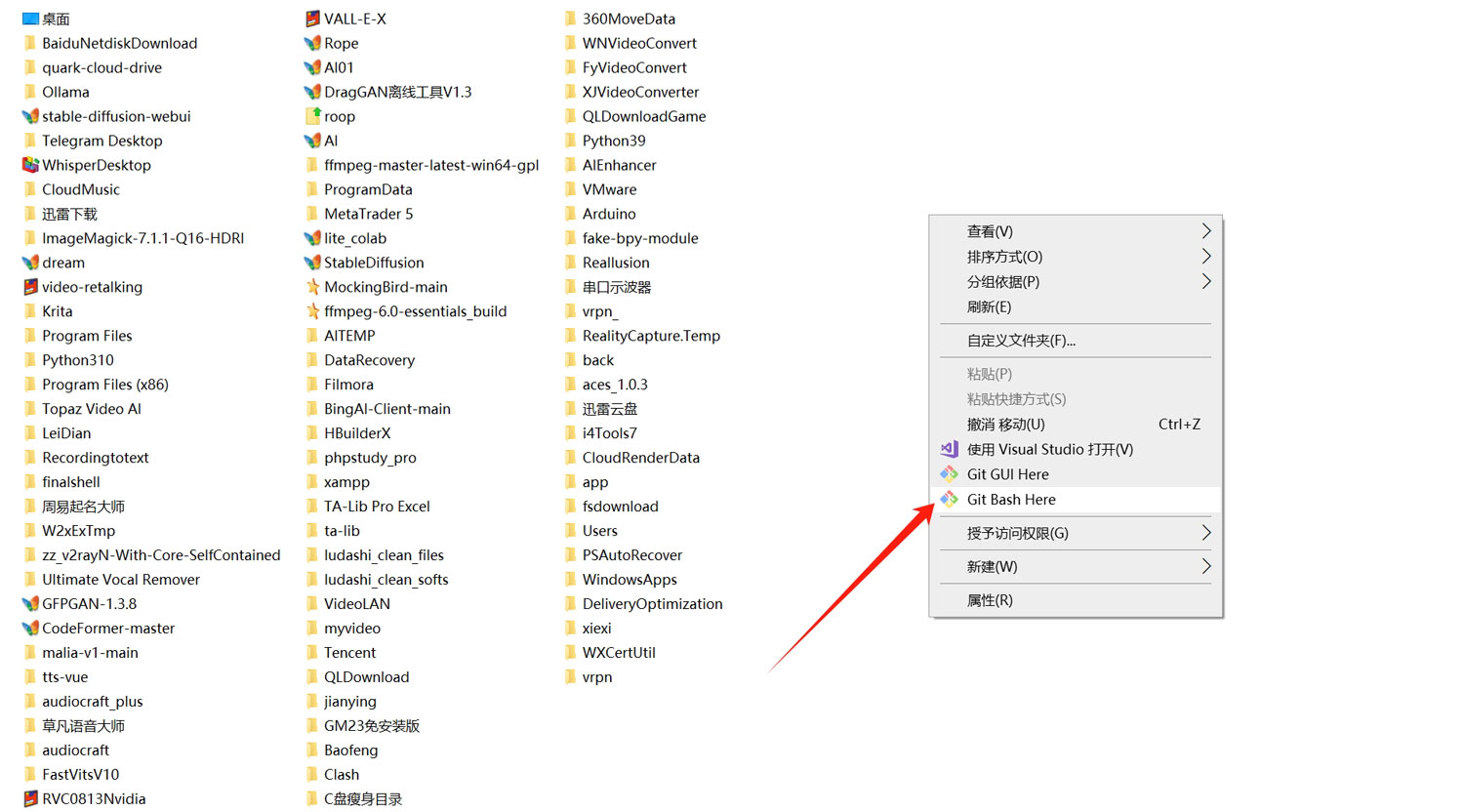

本地部署流程

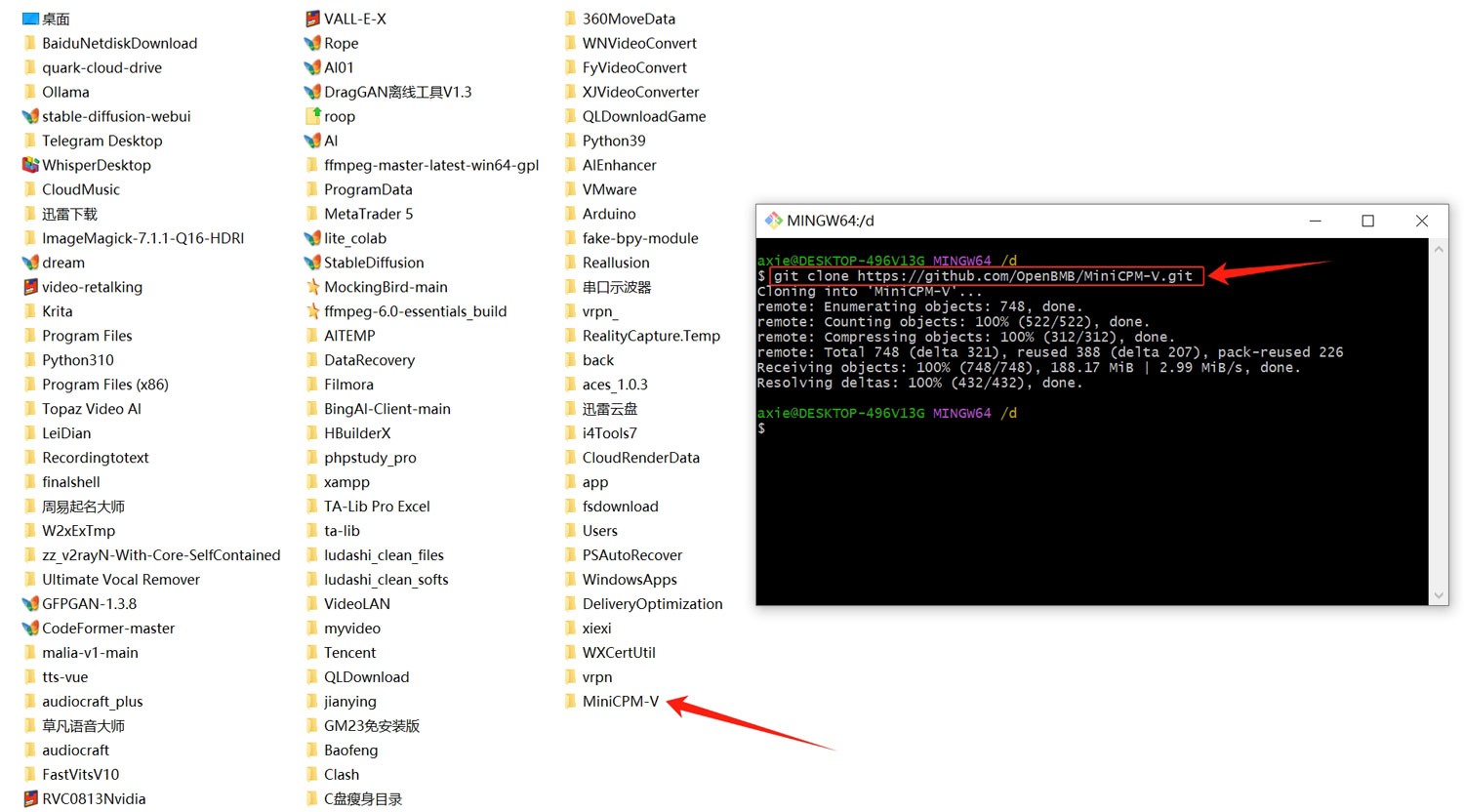

将项目文件克隆到本地

第1步:在文件夹空白处单击鼠标右键,选择“Git Bash Here”选项(如果还没有安装git,需要提前安装,安装方法可以在本博客搜索关键词“安装git”)

第2步:在弹出的git命令窗口中输入如下的命令

git clone https://github.com/OpenBMB/MiniCPM-V.git

该步骤运行完成之后,我们就可以看到在文件夹中多出了一个“MiniCPM-V”的文件,我们进入到该文件夹中!

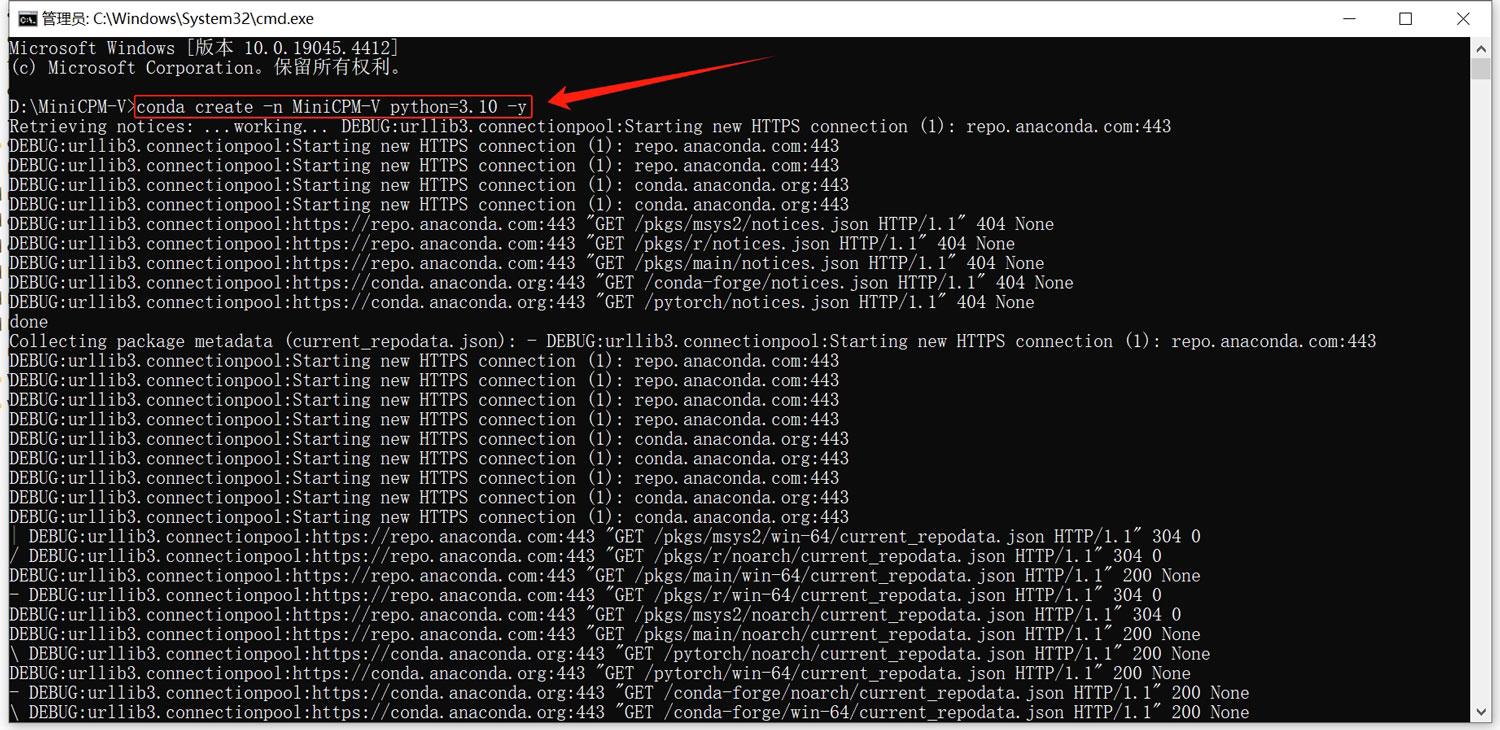

新建和激活虚拟环境

第3步:在文件夹的路径栏输入“cmd”回车,打开一个新的cmd命令窗口

第4步:在cmd命令窗口输入如下的命令,新建一个名为“MiniCPM-V”的虚拟环境

conda create -n MiniCPM-V python=3.10 -y

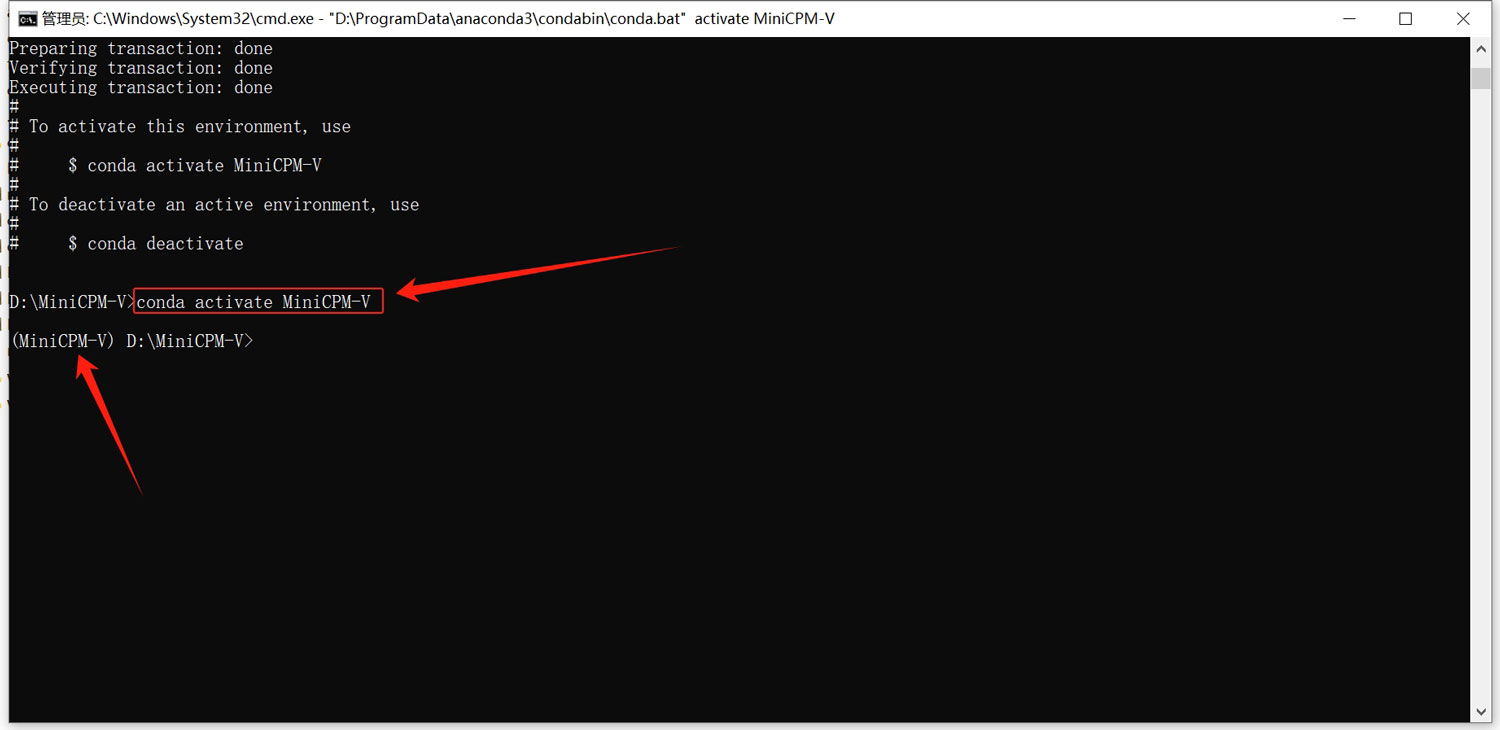

虚拟环境新建完成之后,输入如下的命令激活该虚拟环境

conda activate MiniCPM-V

当我们看到命令输入行的前面有一个带括号的“(MiniCPM-V)”开头时,就意味着现在已经处于该新建的虚拟环境中!

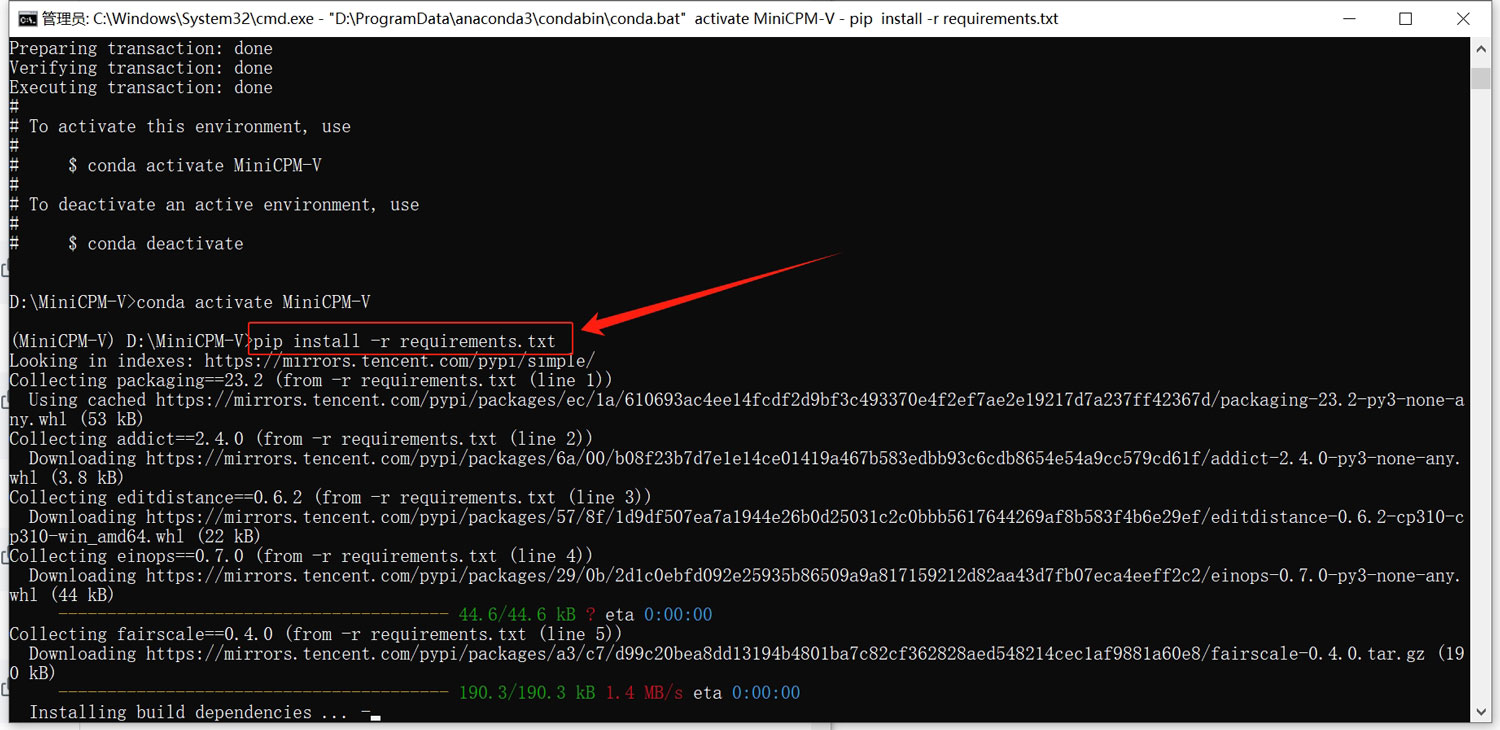

安装依赖

在虚拟环境激活的状态下,输入如下的命令安装项目依赖

pip install -r requirements.txt

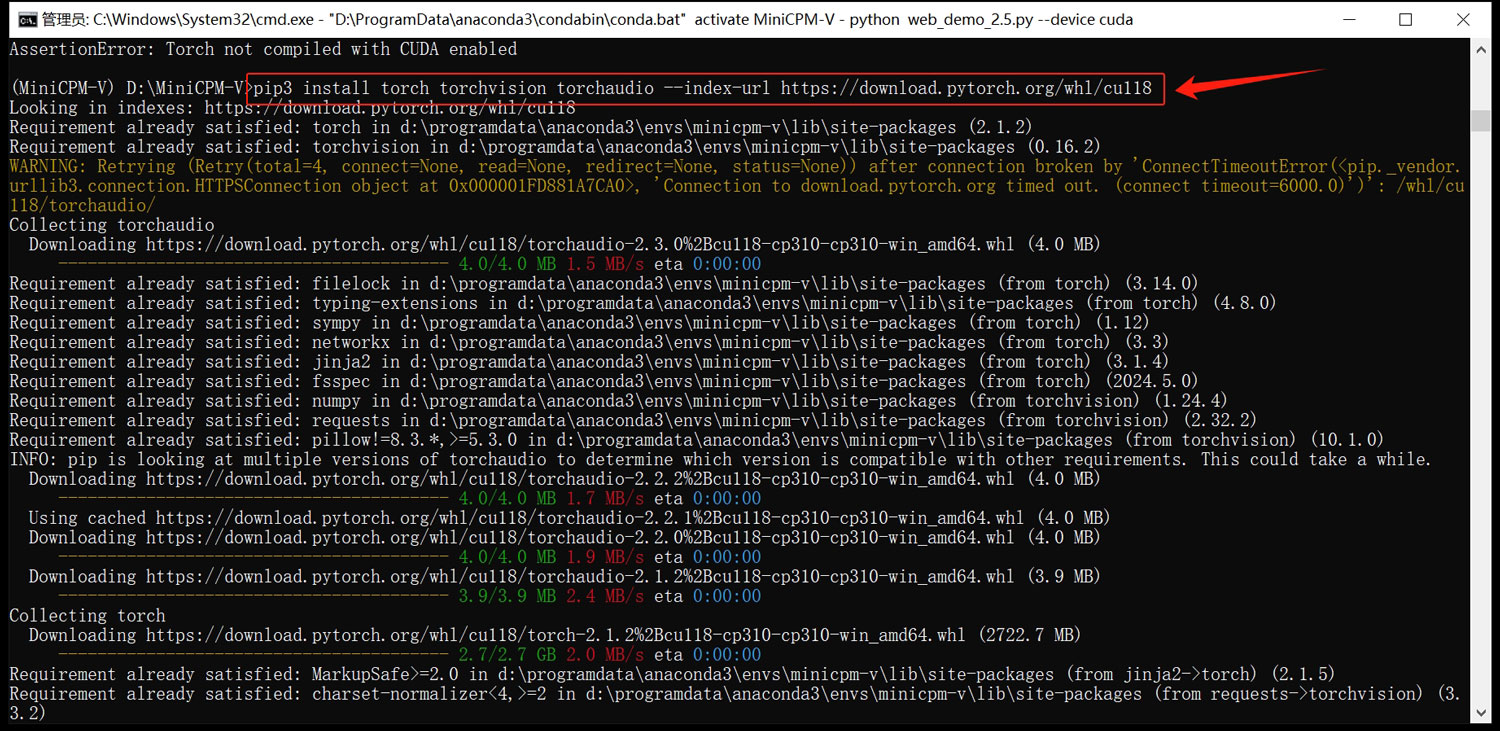

安装torch三件套

如果我们需要用到NVIDIA的显卡和CUDA功能,我们还需要安装torch三件套

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

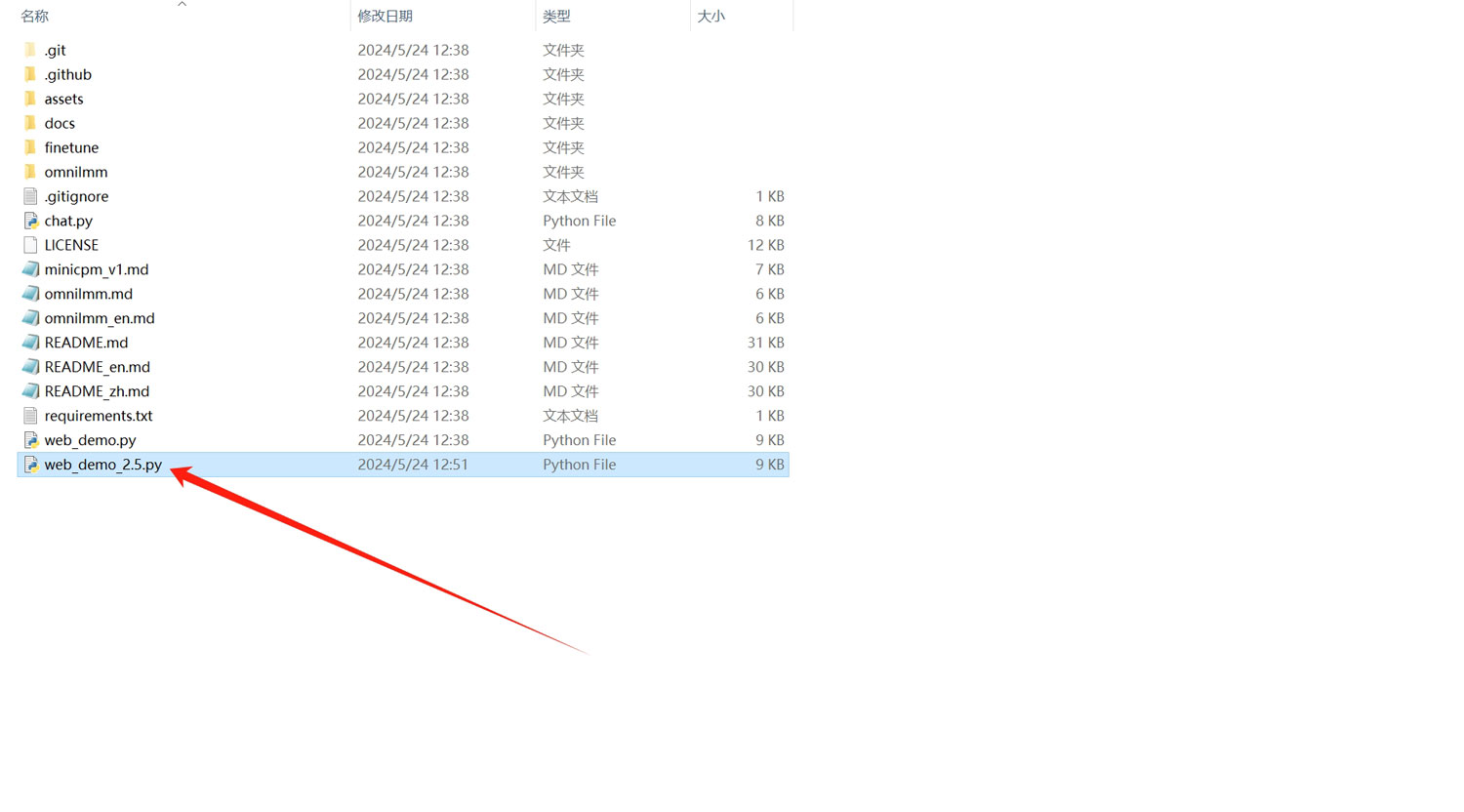

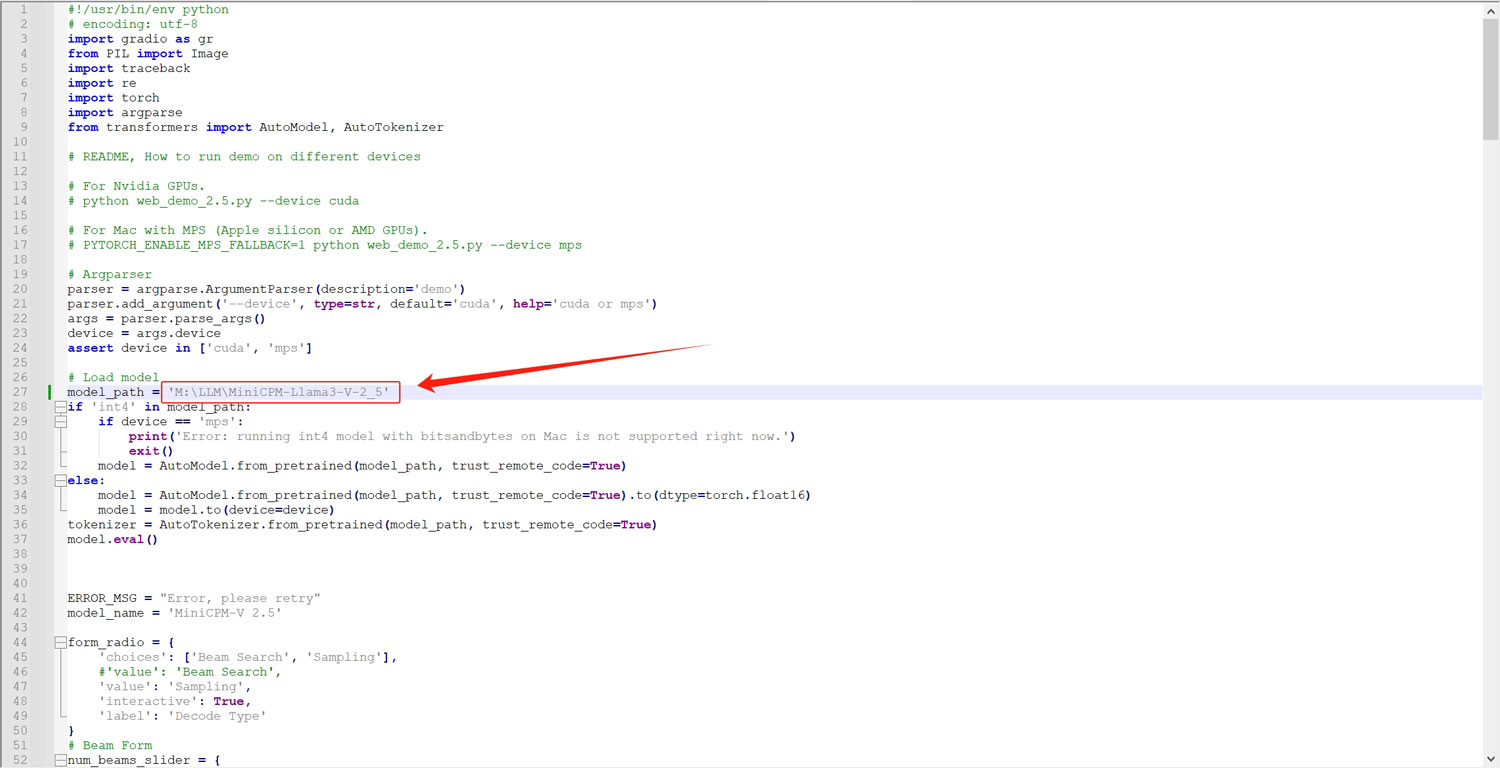

修改web_demo_2.5.py文件

从项目的根目录找到“web_demo_2.5.py”文件,右键用记事本或者是其他文本编辑器打开

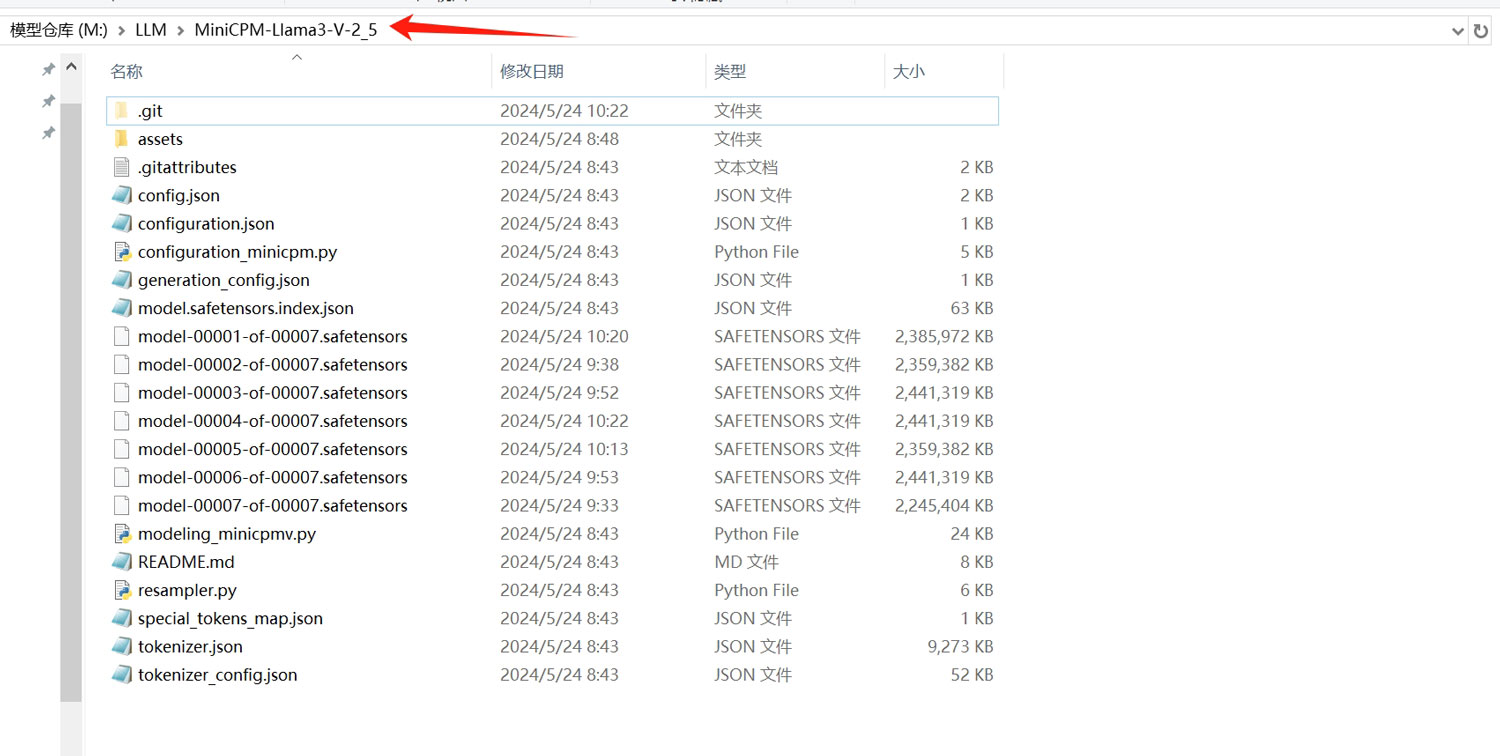

修改模型路径

将文件中的“model_path = ”后面的路径修改为你本地实际的模型路径!比如我的模型保存在M盘的LLM文件中,我将单引号中的路径修改为“M:\LLM\MiniCPM-Llama3-V-2_5”

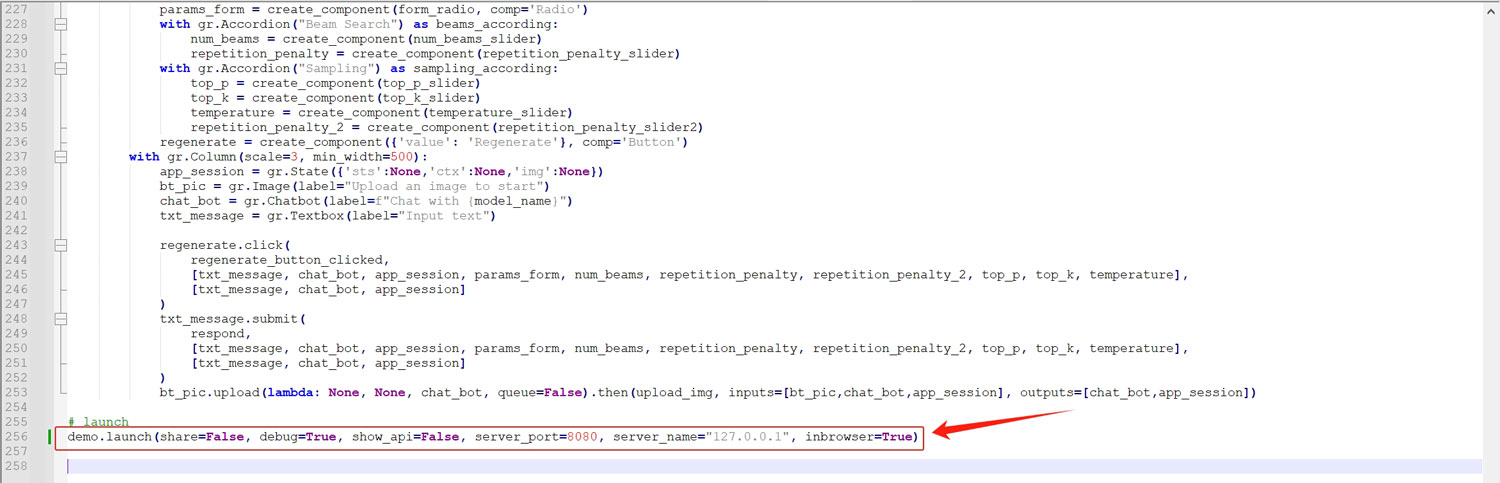

修改页面打开方式

将文件末尾的代码修改为:

demo.launch(share=False, debug=True, show_api=False, server_port=8080, server_name="127.0.0.1", inbrowser=True)

主要是将server_name=”0.0.0.0”修改为server_name=“127.0.0.1”,并且添加inbrowser=True 这个参数!这样修改之后项目运行时会自动打开一个浏览器页面,而不用手动输入!

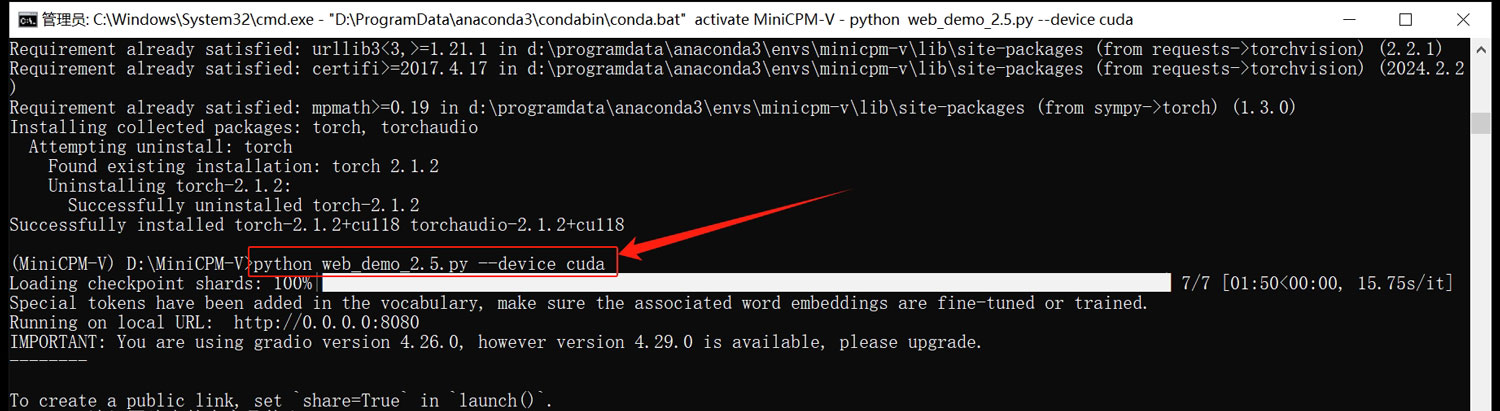

运行webui界面

当上面的所有依赖和环境都安装完成之后,我们就可以运行webui界面了,在虚拟环境激活的状态下,运行如下的命令

python web_demo_2.5.py --device cuda

当显示模型加载完成之后,会自动打开一个浏览器页面“http://127.0.0.1:8080/”

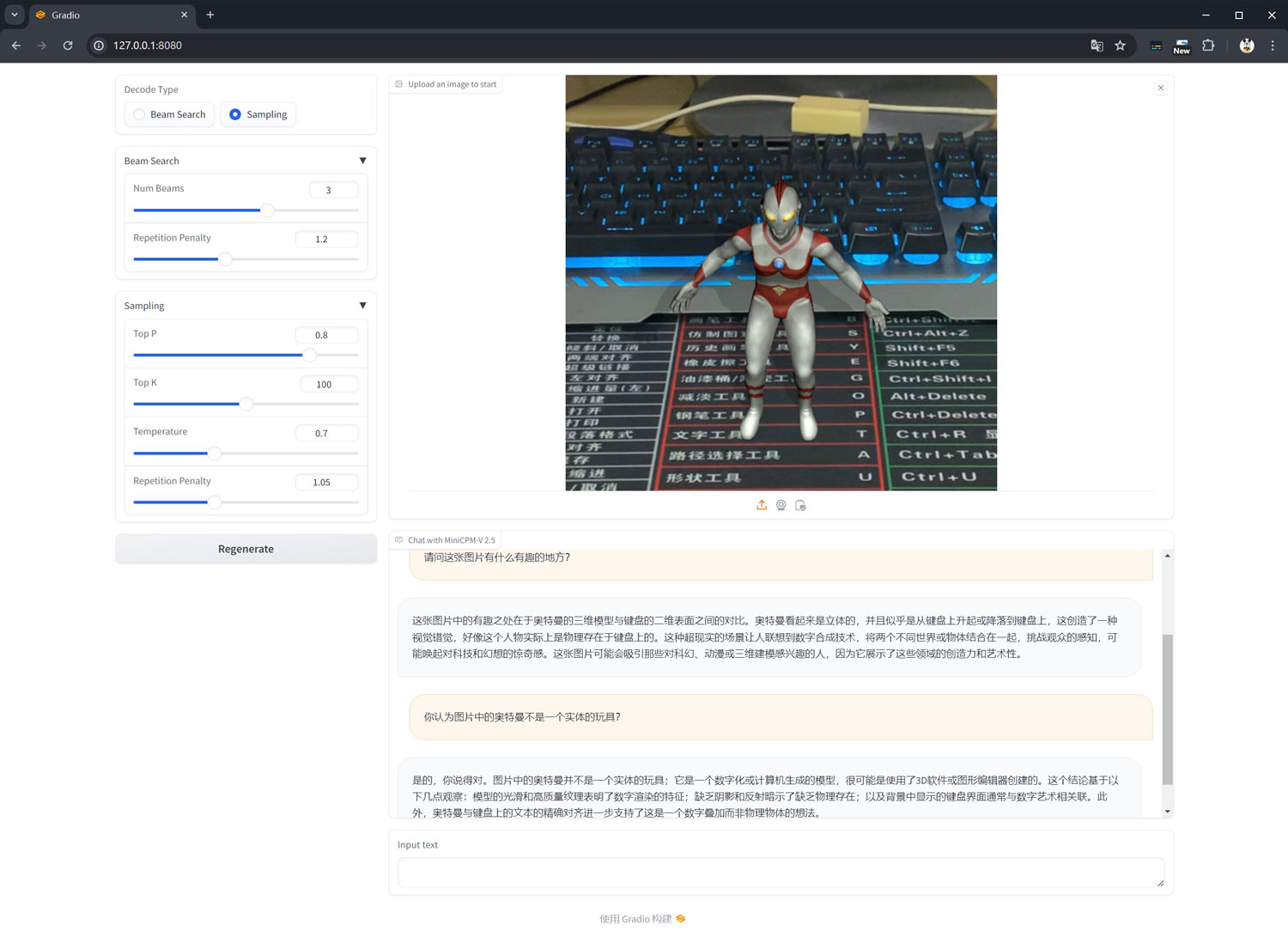

我们可以在页面的左侧调整参数(保持默认也可以),在右侧可以上传一张图片,或者从本地相机拍摄一张图片,然后就可以跟AI进行多模态交流了!

原创文章,作者:朋远方,如若转载,请注明出处:https://caovan.com/minicpm-llama3-v-25-yigekeyizaishoujiduanyunxingdekaiyuanduomotaillm-xingnengqiangguogpt-4v/.html

微信扫一扫

微信扫一扫

![[图文对照]stable diffusion人物服装提示词大全](https://caovan.com/./uploads/2023/08/clothingpromptcaovan-480x300.jpg)