只需一张照片,你就能制作出极具吸引力的“会说话”的视频头像,这一切完全由人工智能创造。当你将不想做的工作交给我时,对我来说,你就是一切。无论是扮演玛丽·托德·林肯帮我赢得总统大选,还是选择离开,门在那里。我的天啊,我爱你的裙子,这是哪里买的,复古风格太可爱了。

Alibaba Emo:https://humanaigc.github.io/emote-portrait-alive/

这将深刻改变视频创作乃至内容创作的方式。现在,我们已经可以将许多图片转化为TikTok上的网红或虚拟YouTuber了。对于这一技术带来的社会影响,人们有不同看法,有人甚至说这项技术真实到让人们将不再需要生育孩子。虽然我不想深入哲学讨论,但我想强调的是,这项技术的技术细节和其重大意义是令人难以置信的。值得一提的是,这项技术并非出自OpenAI之手,而是由中国的阿里巴巴集团推出。他们发布了一款名为EMO的新模型,即在弱条件下利用音频到视频的扩散模型生成表情丰富的人像视频,这远远超出了你所见过的任何东西。

现在,我们正处于一个转折点,我们正在重新定义我们与数字信息的互动方式。这是通过与这些AI系统的合作实现的,也许我们将拥有数个此类系统。它们的表现出奇的好,不仅可以进行对话,还可以唱歌、演讲等多种形式的内容创作。这个系统的技术细节非常精彩,如果你想看几个演示,我会在YouTube描述中放上链接,你绝对会觉得不可思议。

这个系统不仅支持多种语言,还允许使用交叉引用、调整速度等,几乎可以基于此创建TikTok或Instagram Reels内容。人们将会使用这项技术做出更多事情,这是不可避免的。那么,这一切是如何实现的呢?

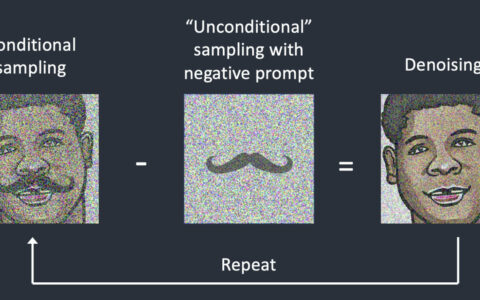

EMO模型通过直接的音频到视频合成方法,克服了传统技术的限制,无需中间的3D模型,也不需要面部标记点。我们的方法确保了帧之间的无缝过渡,并在整个视频中保持一致的身份特征,实现了高度表达力和逼真的动画效果。实验结果表明,EMO不仅能生成令人信服的说话视频,还能生成各种风格的唱歌视频,在表现力和真实感方面大大超过现有的最先进技术。

值得注意的是,这一技术背后的架构包含了多个独特且高质量的元素,例如参考网和速度控制器,这些都有助于控制人物的动作速度和表情。此外,面部定位器的使用,保证了身份的一致性和帧过渡的平滑。

虽然阿里巴巴集团尚未分享代码,但我们期待看到更多来自他们的精彩作品。在技术快速发展的今天,这样的创新无疑将引发对现实本质的进一步思考。我很好奇你对此有何看法,请在评论区分享你的想法。

原创文章,作者:朋远方,如若转载,请注明出处:https://caovan.com/yizhangzhaopiankaiqishipinchuangzuodexinjiyuan/.html

微信扫一扫

微信扫一扫