stable diffusion中的Hypernetwork(超网络)是什么?

Hypernetwork是一种微调技术,最初由stable diffusion的早期采用者NovelAI开发。它是一个附加到stable diffusion模型的小型神经网络,用于修改其风格。

Hypernetwork在我们的课程体系当中,它不是一个重点,我们只需要了解即可!原因有如下几点:

1、Hypernetwork是一个比lora更早的模型微调的技术,现在使用的人数越来越少,我们在C站筛选Hypernetwork,可以发现只有屈指可数的几个Hypernetwork文件,在哩布哩布模型网站可下载的Hypernetwork文件稍微多一些;

2、Hypernetwork的使用效果并不理想,甚至还不如体积只有几k的embeddings文件,但是Hypernetwork的文件体积却可以与lora相提并论,在几十M甚至上百M;

3、Hypernetwork可以实现的效果,用其他的替代方式几乎都可以实现,比如用embeddings或者用lora;

综上所述,我个人并不看好Hypernetwork后续的发展!但是依然值得我们去学习和了解这个微调技术的原理和使用方法!

Hypernetwork与其他模型的区别

checkpoint

checkpoint模型包含生成图像的所有必要信息。您可以通过其文件大小来识别它们。它们的体积范围从 2 GB 到 7 GB不等。Hypernetwork通常低于 200 MB。

Hypernetwork无法单独运作。它需要与checkpoint模型配合来生成图像。

LoRA模型

LoRA 模型与Hypernetwork最相似。它们的文件大小相似,通常低于 200MB,比checkpoint模型小得多。

有一个显而易见的事实是,LoRA 模型比Hypernetwork模型能产生更好的结果。

Embeddings

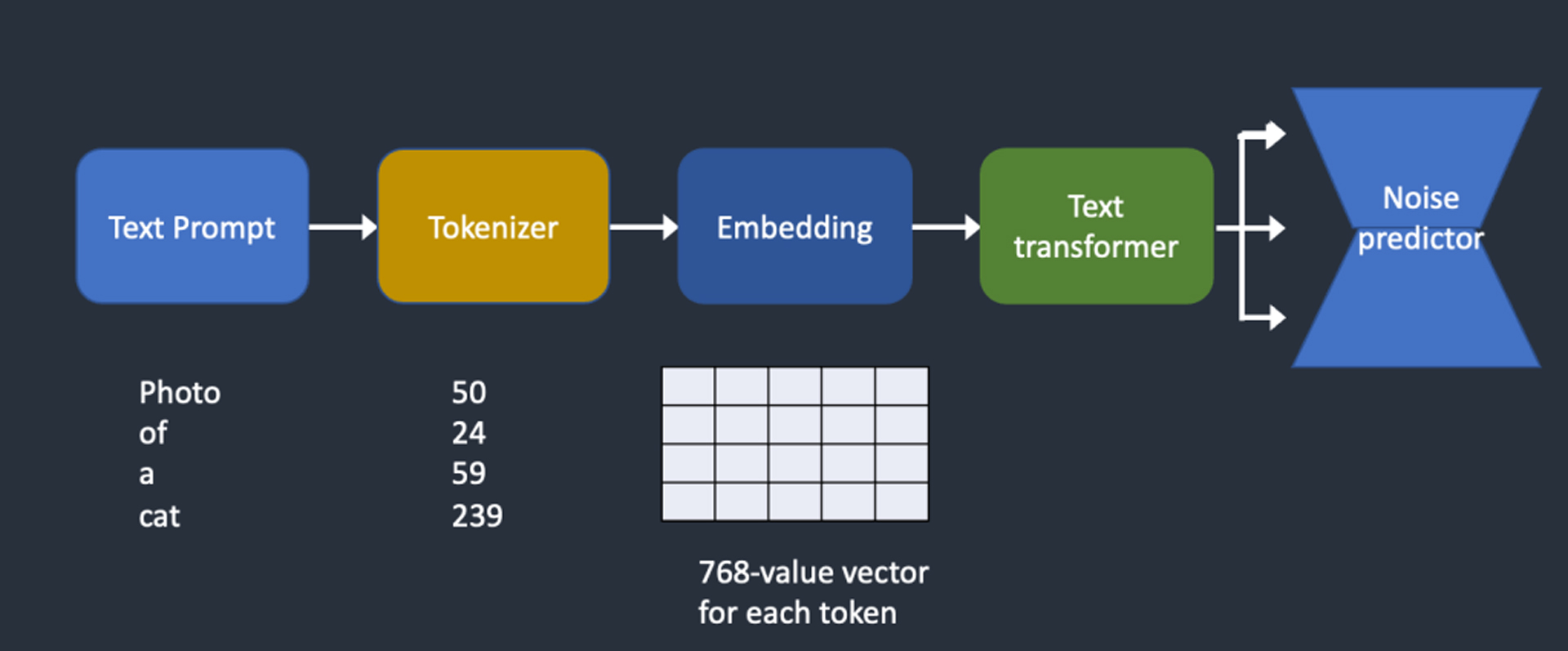

Embeddings是一种称为Textual Inversion”文本反转”的微调方法的结果。与Hypernetwork一样,文本反转不会改变模型。它只是定义新的关键字来实现某些样式。

embeddings和Hypernetwork适用于stable diffusion模型的不同部分。embeddings在文本编码器中创建新的嵌入。Hypernetwork将一个小型网络插入噪声预测器的cross-attention(交叉注意力)模块中。

根据我的经验,embeddings比Hypernetwork稍微强大一些。

原创文章,作者:朋远方,如若转载,请注明出处:https://caovan.com/ruhezaistable-diffusionzhongshiyonghypernetwork/.html

微信扫一扫

微信扫一扫

![[图文对照]stable diffusion人物姿势提示词大全](https://caovan.com/./uploads/2023/07/poses-promptcaovan-480x300.jpg)